大学院 工学研究科 制御機械工学コース 准教授

大阪大学

休日は子育て中心で過ごしています。最近、子どもが情報技術に強い関心を示すようになってきました。画像処理、機械学習、計測制御の技術を使って、子ども向けに何か面白いデジタルAIおもちゃをつくることができないか、構想中。

人を「みる」技術で

暮らしをもっと豊かに

眠くなる前に話しかけてくれる車。目で合図を送るだけで動き出すエアコンやお掃除ロボット。人にやさしいスマートな機械は、人を「みる」ことから始まります。

疋田准教授は、目から人の状態を推定する技術や、目やまぶたの動きで情報機器を操作する技術開発を通して、人にやさしいものづくりをめざしています。

目は口ほどにものをいう!?

視線で情報機器を動かす技術

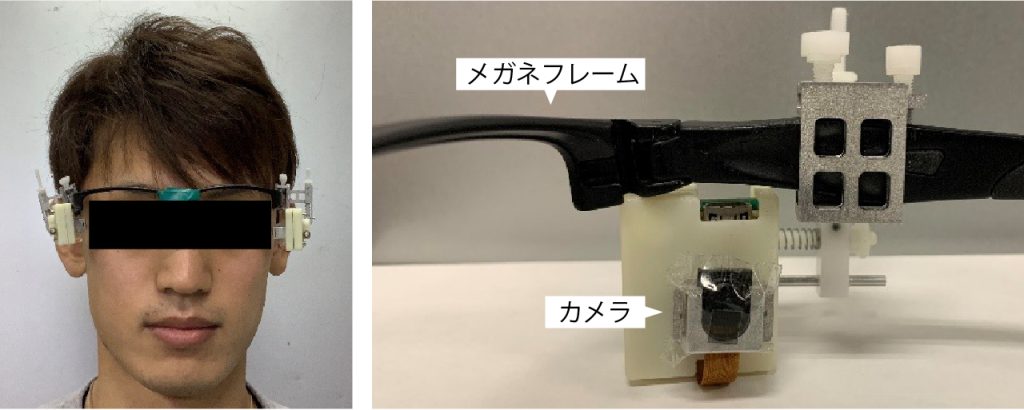

疋田准教授が進めているのは、視線の動きでパソコンなどを操作できるインターフェースの開発です。障がいのある人のコミュニケーションにも役立ち、画面から離れていたり、両手がふさがっていたりする時にも操作が簡単にでき便利です。疋田准教授は、現在、日常生活で使いやすいよう、眼鏡のフレームにカメラを取り付けるデバイスを開発中。

視線の推定には、瞳孔や虹彩などの形状の変化を利用しますが、目の正面からでなく横からの画像で視線の検出を行うのは至難の業。まだ他にはない新技術の開発に挑戦中です。

また視線の方向だけでなく、視線を使った簡単なジェスチャーの検出にも取り組んでいます。現段階で検出できる動作の中には、たとえば、少し頭を振ってうなずくようなジェスチャーなどがあります。目の合図だけで機器の操作がどこまで実現できるのか、楽しみな研究です。

次世代の技術者育成のために

ARを利用した目で見てわかるロボット教材の開発

また疋田准教授では、次世代を担う技術者育成のために、ARを利用したロボット教材の開発にも積極的に取り組んでいます。

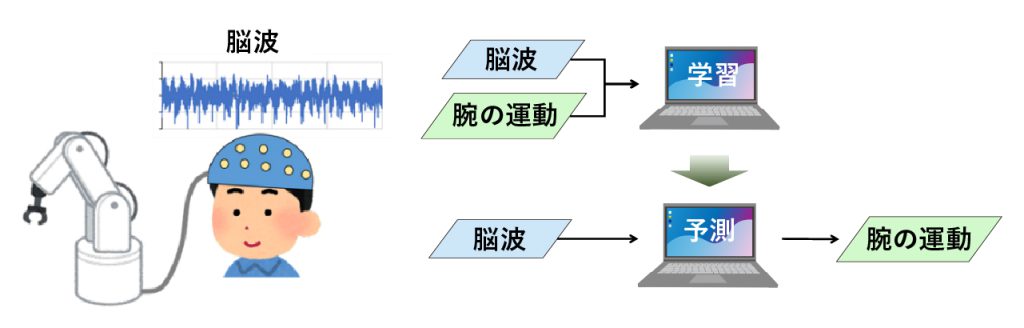

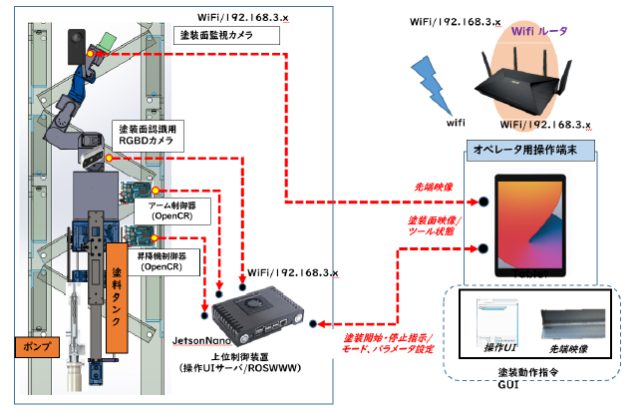

私たちが相手の顔を見て「眠そう」「疲れている」「楽しそう」といったさまざまな情報を読み取るように、機械も上手に私たちを「みる」ことができれば、人の気持ちを理解し、自発的に手助けしてくれるやさしいロボットの誕生につながるかも知れません。疋田研究室で取り組んでいるのは、人間が視覚(目)から得ている情報を判断し、次の動作を決めているのと同じように、ロボットもカメラ(目)から得た情報で状況を判断し、動作できるようにするしくみの開発です。

開発中の教材をいくつか紹介します。2つの動画から、自動運転のしくみについて考えてみると、ARを利用したロボットについて理解が進むかも知れません。同時に、ロボットと共に生きる近未来が見えてくるかも知れません。

ロボットの目は

どこまで未来を見通す!?

ロボットの目、つまりカメラは、画像処理技術などを応用して人以上の能力を発揮します。視線をはじめ、人が認識することが難しいものを正確に把握する技術の発達は、健康の維持やコミュニケーションの向上をもたらし、人の暮らしを豊かにしてくれそうです。

一方で、人の視線は、眼球や筋肉の動きなど複雑な制御機構の賜物だとか。人と機械との「いいとこどり」によって、ロボットの視覚に関する技術がどこまで発展するのか?その先の未来に期待が高まります。

各種取材や研究に関することなど、

お気軽にお問い合わせください