大学院 総合情報学研究科 コンピュータサイエンスコース 准教授

大阪大学

休みの日には自分のプログラムを書いています。新しいことを覚えて、プログラミングのスキルが錆びつかないようにするためでもありますが、それよりも大きな理由は「楽しいから」だそうです。

ディープラーニングで

AIをもっと「使えるヤツ」にする

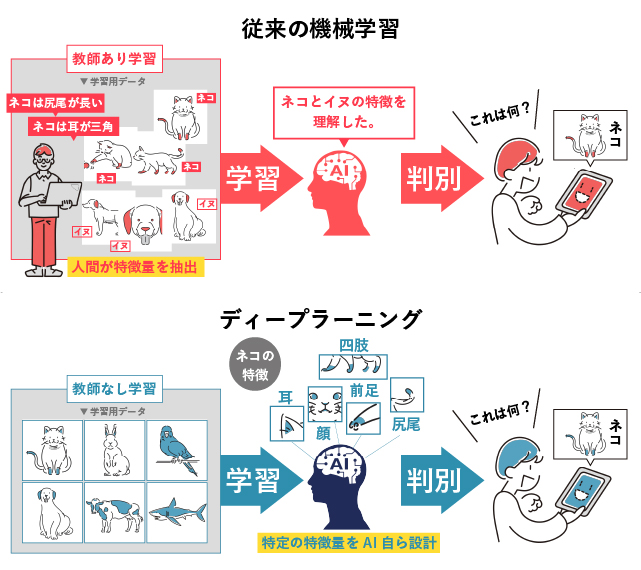

AIが広く実用化されるようになったのは、ディープラーニングと呼ばれる、大量のデータ解析によってデータの特徴を認識する技術が進化したからだと言われています。

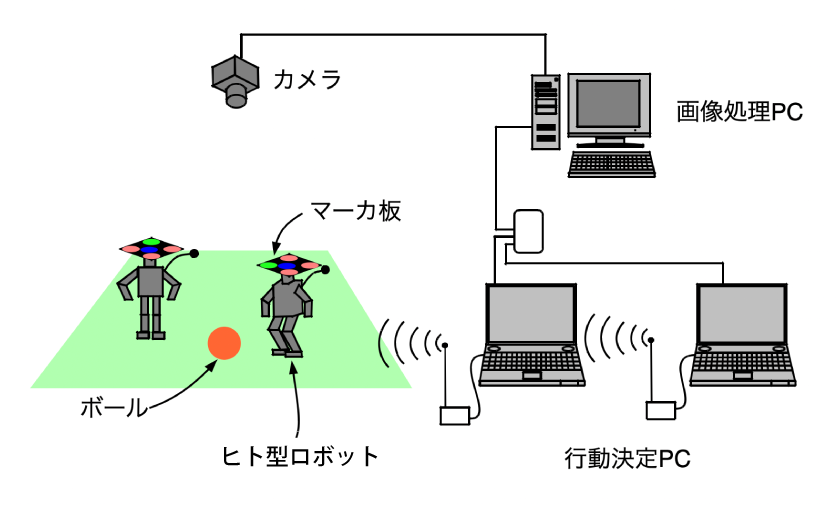

久松研究室ではAIの性能向上につながるディープラーニングや、通信ネットワークへの応用を研究しています。

膨大なデータを学習したAIの

性能をあげるファインチューニング

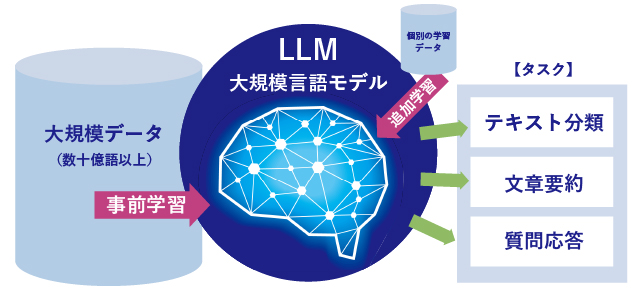

人間との対話によって、流暢で自然な文章を自動生成するChatGPT。これら生成AIには、事前に膨大なテキストデータからディープラーニング技術を使って言語知識を学習させ、自然言語を用いたさまざまな処理を高精度に行うAIモデル、LLM(大規模言語モデル)が使われています。

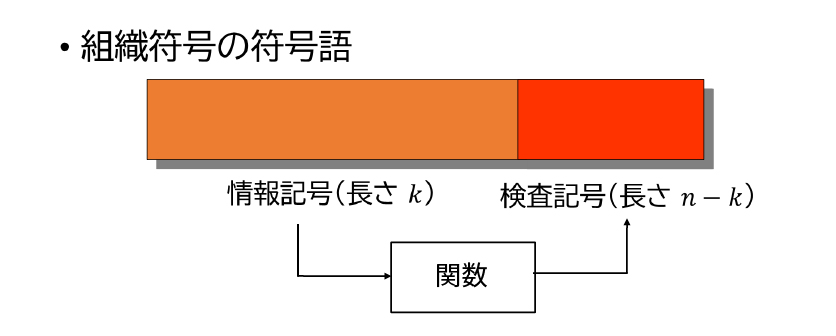

LLMの開発には、膨大なテキストを与えて一般的な言語知識を学習させる「事前学習」と、翻訳・対話などAIにさせたいタスク(仕事)に適したデータで再度学習させて調整する「ファインチューニング」の2段階があります。

久松研究室の研究テーマの一つは、このファインチューニング。モデルの構造やパラメータの設定による処理精度や学習時間への影響、プロンプトの評価や調整などを通してLLMの性能を高めています。

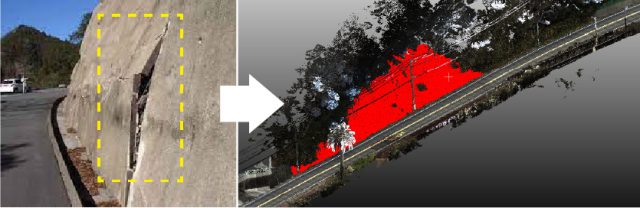

従来の機械学習では,前処理として人間が情報を整理し,特徴量を抽出する必要があった.しかしディープラーニングの学習システムでは,人間が介入することなくAI自らが特定の特徴量を設計し,学習してゆく.

膨大なテキストを与えて一般的な言語知識を学習させる「事前学習」とタスク(仕事)ごとに追加学修で調整する「ファインチューニング」.この2段階で開発が進む.

通信ネットワークの混雑解消に

AIの分析力を役立てる

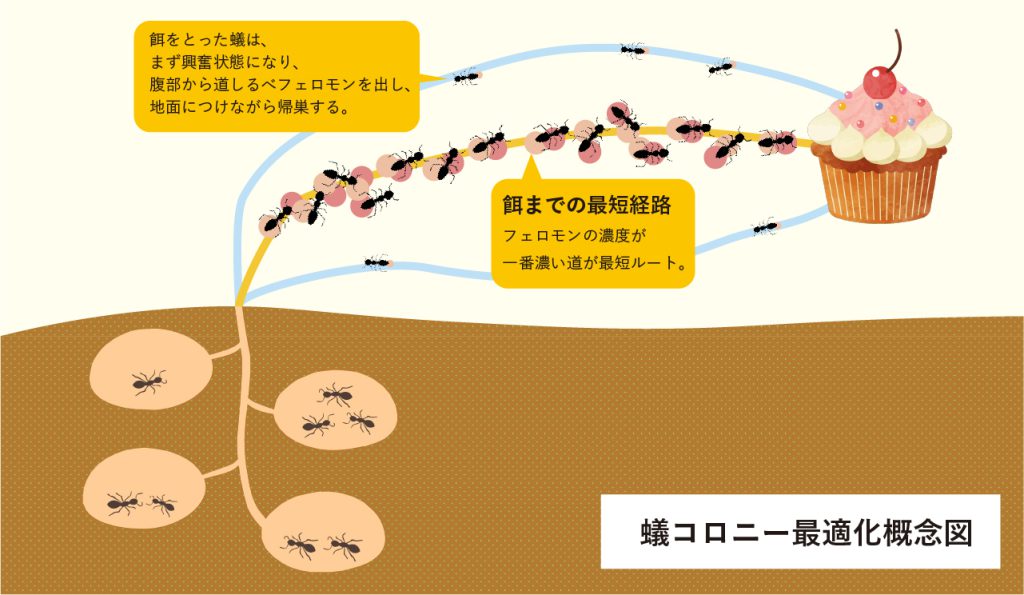

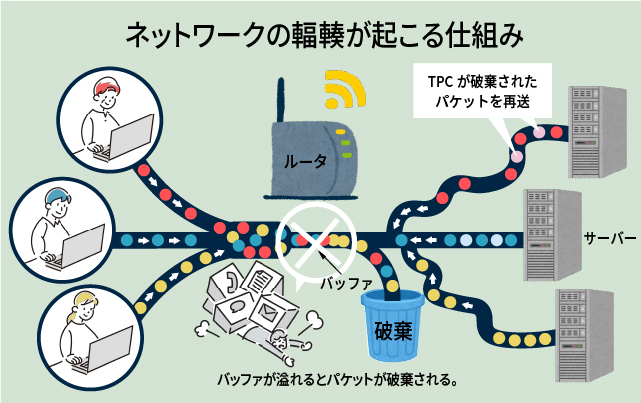

久松研究室では、ネットワークの輻輳制御(ふくそうせいぎょ)にディープラーニング技術を応用する研究も進めています。輻輳制御とは、通信ネットワークに許容量を超える伝送の要求が殺到して混雑するのを防ぐことです。

特にインターネットにおいて広く利用されているプロトコル、TCP/IPにおいては、輻輳を避け効率よくデータを転送するためのさまざまなアルゴリズムが提案されてきましたが、決して満足のいく制御が行われているわけではありません。

久松准教授は、輻輳も含めた伝送状況のAI分析が進めば、従来見つけられていなかった方法での制御ができるのではないかと、期待しています。

AIは数学研究でも成果

人間より賢くなる日はくるのか!?

AIは膨大なデータを利用することで、どんどん「確からしい」答えを出せるようになりました。今後もコンピュータの処理スピードの向上に伴って、できることが増えていくでしょう。2021年には、AIを使った数学研究で、AIが新しい定理を発見したり証明されていない問題の予想に役立つ新たなバターンを発見したそうです。

これが数学者に匹敵する直観の賜物なのか、単なる偶然なのか。AIは人間にどこまで近づくことができるのでしょうか。

各種取材や研究に関することなど、

お気軽にお問い合わせください