人間が自ら解決策を導き出すための

良き相談相手になれるAIを研究

私たちの質問に答えてくれる対話型のAIやチャット等が増えていますが、コンピュータは本当に私たちの質問を「理解」しているのでしょうか。

自然言語処理を扱う竹内研究室では、「“わかる”とは何か」に注目しながら、人の相談者になれるAIを研究しています。

世間で活躍するAIの作業の多くは

「思考」や「理解」というより「翻訳」

「リンゴとは何か説明してください」と質問されたら、多くの人は「木になる赤い果物」と答えるでしょう。けれども、答えの続きは、たとえばリンゴ農家と画家ではかなり異なるはずです。両者が対話すればリンゴの知識が増え、お互いに対する理解も深まります。その後リンゴを育てる時、あるいはリンゴを描く時のヒントを得るかもしれません。

一方、最近のAIに同じ質問をしても、ある程度詳しく答えてくれますし、私たちが日常話す言語である自然言語を使ってやりとりするので、AIが考えているように感じます。しかしそれは「リンゴ」という単語に紐付いた文言を取り出しているだけであってコンピュータがリンゴについて理解して答えているわけではありません。

自動翻訳・自動チャット・要約・絵を書くツール等もコンピュータが考えているのではなくプログラムに沿って該当する文言や絵を提示している「翻訳技術」なのです。

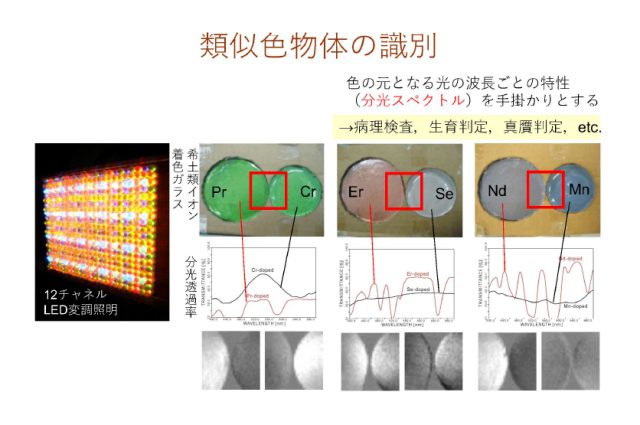

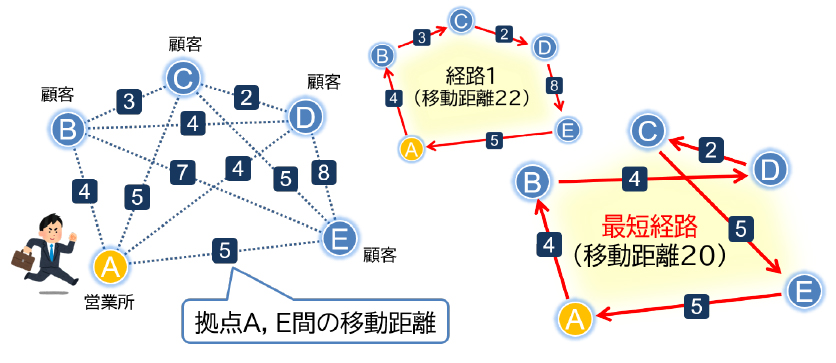

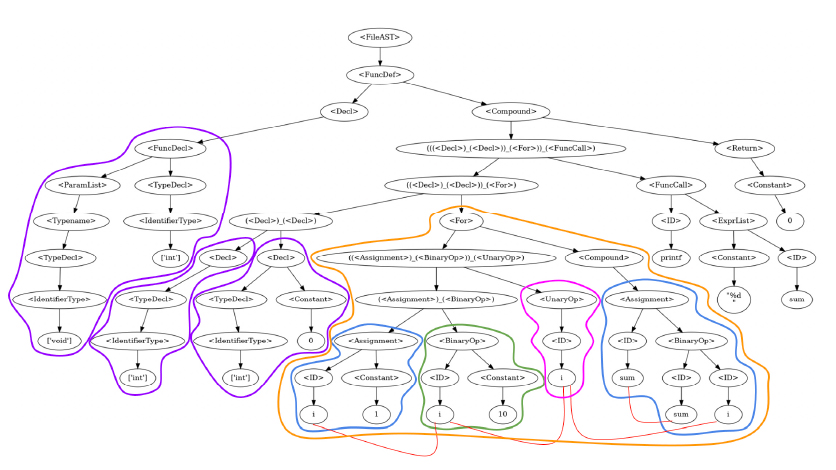

色で囲んでいるところは「変数に値を代入」といったプログラムでよく使う言葉で表現できる部分を示している.つまり人間の言葉からプログラムを生成する基礎となる.

汎用型「翻訳」からオーダーメイド「通訳」へ

対話の実現に必要な「意図の推論」をめざす

英語から日本語への自動翻訳など、翻訳技術の精度は高くなっていますが、AIと話が噛み合わない経験をした人も多いと思います。これは、「リンゴは赤い」とだけ定義すると青リンゴはリンゴでなくなってしまうように「Aを語るとA以外を捨てる」という言葉の持つ特性と関わっています。

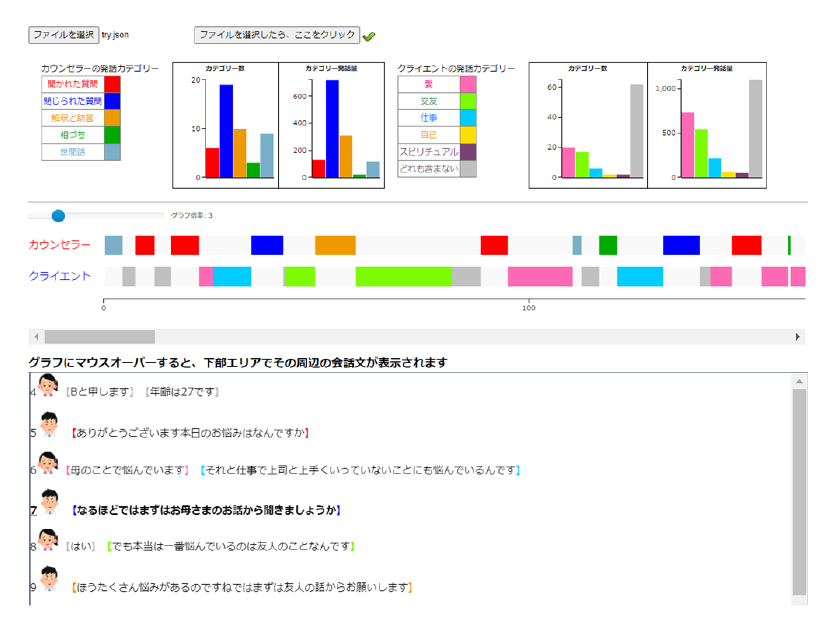

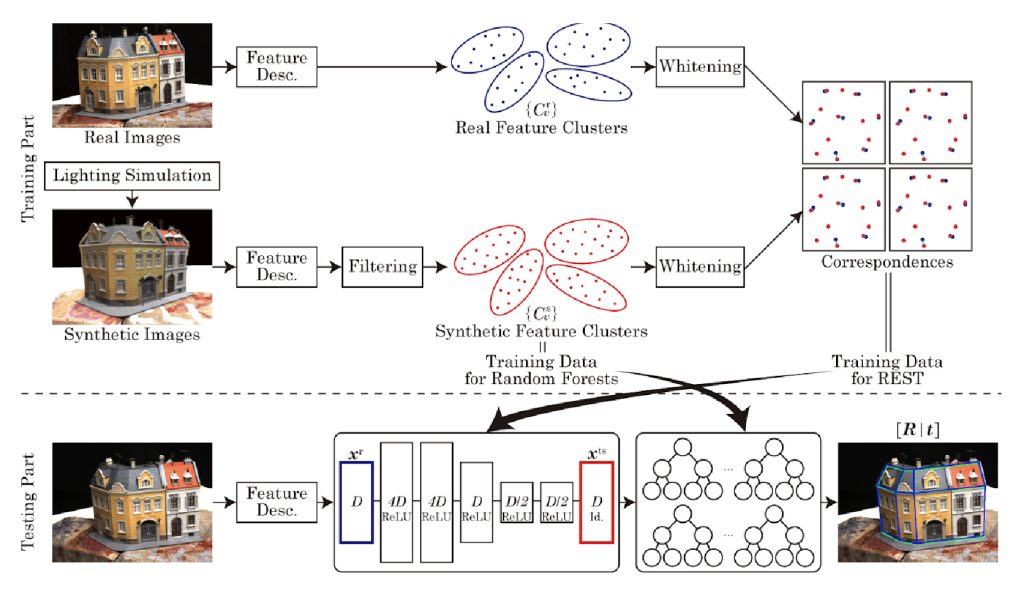

こうした誤りを防ぐにはコンピュータと「対話」を重ねてリンゴの意味をより豊かにすることが不可欠です。対話を増やすことで、AIは前後の文脈や問題の個別性をふまえた内容を返すことができます。つまり翻訳から通訳へのバージョンアップです。AIが対話を実現するには人間の意図を推論する必要があります。

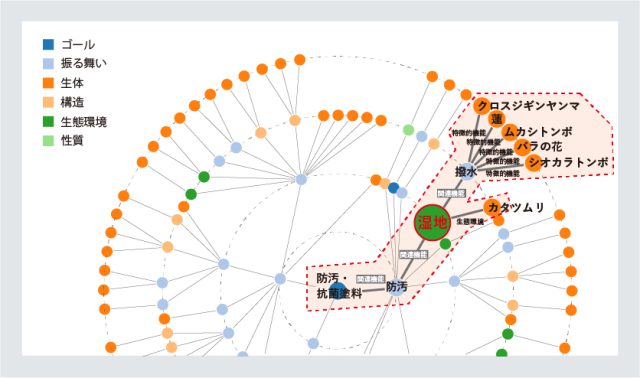

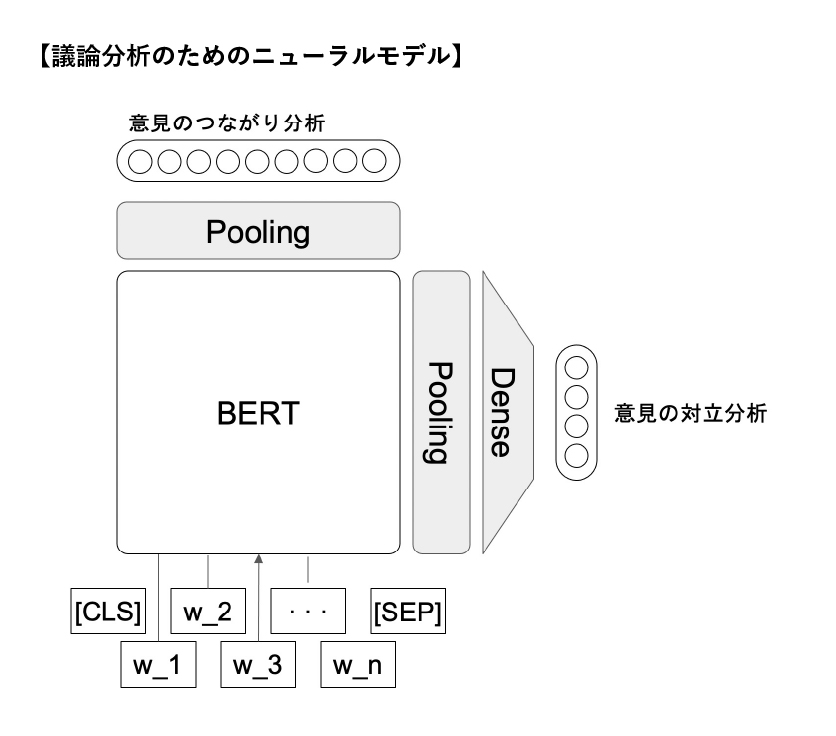

竹内研究室ではネット上にあるさまざまなテキストを機械学習で解析し、さまざまな意図パターンを整理しています。「わかるとは何か」というAIの根源を見つめ直す研究でもあるのです。

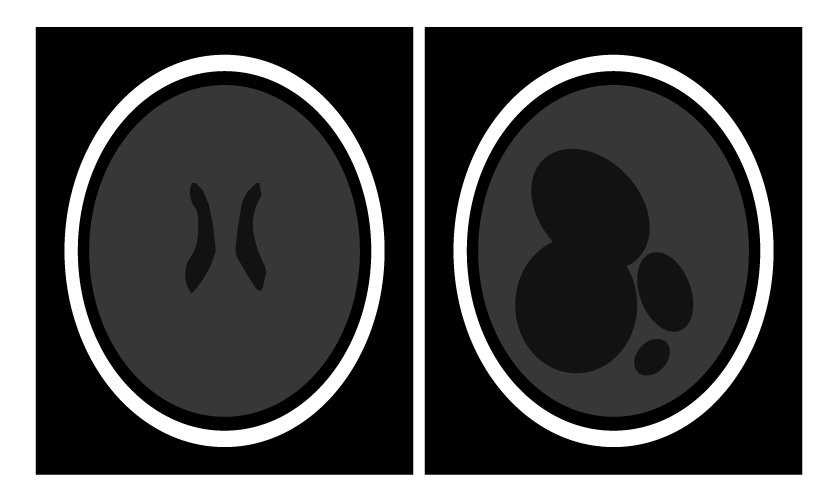

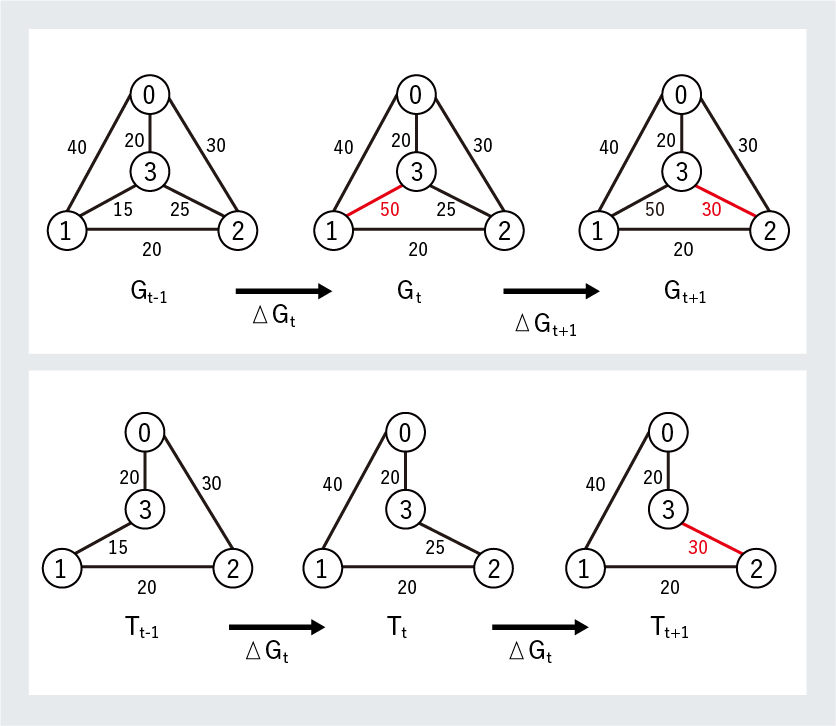

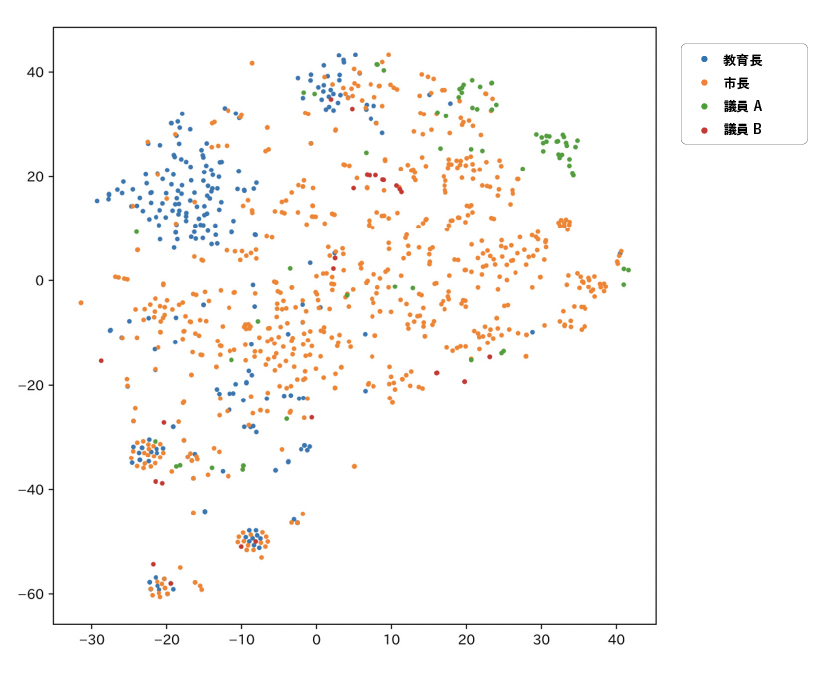

横軸・縦軸で作られた平面上の点は特定の話題を示す.それぞれの点はそれぞれの話者が言及している話題. 話者は色分けされているため,どの話題に対して複数の話者が密接に議論をしているかが分かる.

近年発展の著しい深層学習は言葉の意味をベクトルで表現することができる.開発した手法では, 言葉の意味を一方向だけではなく縦方向と横方向の二方向から分析することができる.

難しい問題をあなたと一緒に考える専門分野ボット

人間の判断を支援する!

専門知識を持ち、人間の意図を理解するAIが実現すれば、質問者と対話を重ねて個別の状況に応じたアドバイスをする法律ボットや医療ボットとして、弁護士や医師の代わりに気軽に相談できます。

また、行政の議事録や裁判記録を読み込むことで、結果だけでなくプロセスをふまえた行政や司法のチェックが可能になります。ここで大切なのは、AIは選択肢を提示する援助的存在であり、最終判断をするのはユーザである人間だということです。

各種取材や研究に関することなど、

お気軽にお問い合わせください